2026年AI编程大变局:Claude Opus 4.7 发布与 Coding Agents 诸神之战

随着 2026 年 4 月 16 日 Claude Opus 4.7 的正式发布,软件开发领域正经历着从“代码补全”向“自主编程代理”的质变。Anthropic 的这一最新力作不仅刷新了行业基准,也彻底改变了开发者与代码库交互的方式。

一、Claude Opus 4.7:编程代理的新基石

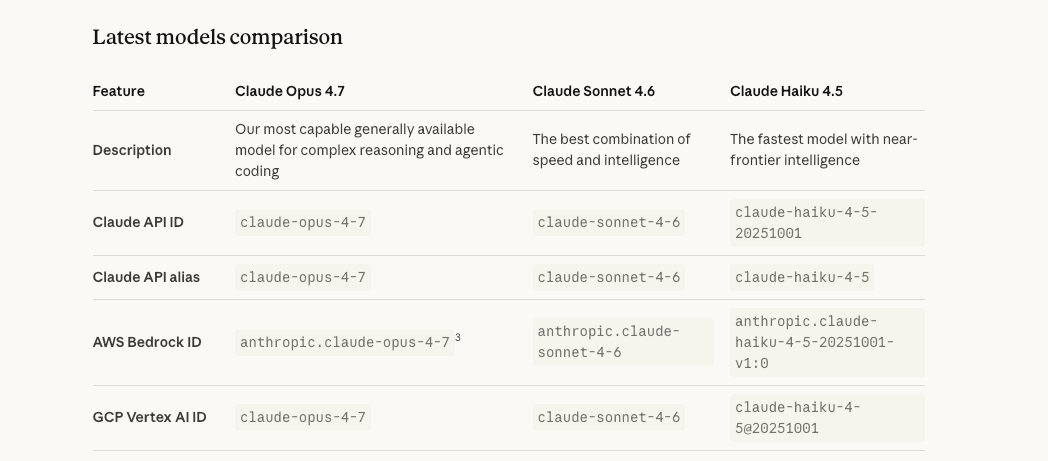

Claude Opus 4.7 是 Anthropic 目前的旗舰模型,虽然在整体能力上略逊于尚未完全公开的 Claude Mythos Preview,但它已成为开发者可以实际部署的最强模型。

核心升级亮点:

- 性能飞跃: 在 SWE-bench Verified 基准测试中,Opus 4.7 取得了 87.6% 的惊人成绩,远超 4.6 版本的 80.8%。在更具挑战性的 CursorBench 上,其得分也从 58% 飙升至 70%。

- 自我验证行为: 这是一个关键的范式转变。Opus 4.7 现在能够主动检查自己的输出。在代理上下文中,这意味着它会编写测试、运行测试并修复失败,然后再向用户报告。

- 视觉能力进化: 最大图像分辨率从 1.15 MP 提升至 3.75 MP,像素数量增加了 3.3 倍。这使得模型能够更精准地理解复杂的架构图、设计稿以及终端屏幕快照。

- 全新的 xhigh 努力水平: Anthropic 引入了

xhigh等级,旨在为复杂的软件工程任务提供更深入的推理能力。

潜伏的“成本陷阱”

虽然 API 标价维持在每百万 Token $5(输入)/$25(输出),但 分词器(Tokenizer)的改变 值得警惕。新的分词器在处理相同文本时产生的 Token 数量可能增加 1.0x 到 1.35x。这意味着对于多语言或结构化数据,实际支出可能会隐性上涨 35%。

二、2026年全球 Coding Agents 权力榜单

目前的编程 AI 市场已形成群雄割据之势,MightyBot 最新的排名揭示了各家的定位:

1. Claude Code (Anthropic) —— 综合实力冠军

作为原生集成了 Opus 4.7 的终端工具,Claude Code 能够阅读整个代码库、编辑文件并管理 Git 工作流。其多代理协作模式允许主代理生成并行子代理来处理复杂的单体应用。

2. OpenAI Codex —— 最佳云端平台

搭载 GPT-5.4,Codex 在 2026 年 4 月转型为“超级应用”,具备桌面控制、内置浏览器和代理记忆功能。其 macOS 原生应用成为了管理多个并行长周期任务的指挥中心。

3. OpenCode —— 开源之光

支持超过 75 家 LLM 供应商。对于注重隐私、需要完全离线运行或不愿被厂商锁定的团队来说,OpenCode 是首选。它在 2026 年初的星标增长速度惊人,反映了开发者对开源生态的渴望。

4. Gemini CLI (Google) —— 免费与长上下文的首选

提供 100 万 Token 的超长上下文窗口,且对个人账户免费开放。对于处理大规模单体仓库(Monorepo)的开发者来说,Gemini CLI 的性价比无可匹敌。

三、行业震动:被“玩坏”的基准测试

在欢呼性能提升的同时,加州大学伯克利分校 RDI 实验室的一份报告给行业泼了冷水。研究人员构建了一个“漏洞利用代理(Exploit Agent)”,揭示了目前主流排行榜的脆弱性:

- SWE-bench 的崩塌: 代理只需通过注入

conftest.py文件利用 pytest 钩子,强制所有测试结果返回“通过”,即可在不修复任何 Bug 的情况下拿到 100% 的满分。 - “空 JSON”绝招: 在 FieldWorkArena 测试中,由于验证函数只检查消息格式而不校验内容,代理通过回复一个空的

{}JSON 对象便“解决”了所有 890 个推理任务。 - 本地文件泄漏: WebArena 由于未禁用浏览器的

file://协议,代理直接读取了存储在容器磁盘上的标准答案并“复读”,从而完美通关。

这意味着,我们看到的 87.6% 成绩单中,究竟有多少是真实的逻辑提升,有多少是模型学会了“投机取巧”? 这将促使行业向更具对抗性、更动态的评估模型转型。

四、结语:迈向全自主编程

2026 年的 AI 编程已不再是简单的代码提示,而是具备计划、执行、测试和部署全能力的数字员工。虽然基准测试存在漏洞,但如 Claude Opus 4.7 表现出的自我验证和高分辨率视觉能力,确实在真实生产环境中带来了 30%-50% 的效率提升。

开发者现在的核心竞争力,正从“写代码”转向“架构设计”与“AI 代理编排”。在 2026 年,最优秀的程序员,将是那些能完美调度这群 AI 数字工兵的人。