AI 原生开发的未来在本地:深入解析 Continue 的 LanceDB 进化之路

随着人工智能技术的飞速发展,AI 编程助手已成为开发者工作流中不可或缺的一部分。然而,在提升生产力的同时,代码隐私、延迟以及对云端服务的依赖成为了企业和个人开发者关注的核心挑战。在这一背景下,Continue 选择了“本地优先”的架构路线,并联合 LanceDB 共同打造了下一代 AI 原生开发体验。

重新定义 AI 编程:为什么选择本地化?

Continue 是一款面向 VS Code 和 JetBrains 的开源 IDE 插件,旨在将 AI 从一个死板的工具转变为开发者的“协作伙伴”。与许多依赖云端 API 的助手不同,Continue 默认在本地运行,将数据安全地存储在用户机器的 ~/.continue 文件夹中。

开发者面临的挑战

传统的代码搜索工具主要依赖关键词匹配,这在处理庞杂的代码库时往往力不从心:

- 无法理解语义:难以识别功能相似但语法不同的代码片段。

- 高延迟:云端检索带来的等待时间打断了开发者的心流。

- 隐私隐患:敏感的商业逻辑代码上传至云端存在安全风险。

为了解决这些痛点,Continue 需要一个高性能的向量数据库,既能嵌入到 IDE 环境中,又能在无需复杂基础设施的情况下处理海量向量数据。

核心引擎:LanceDB 如何赋能 Continue

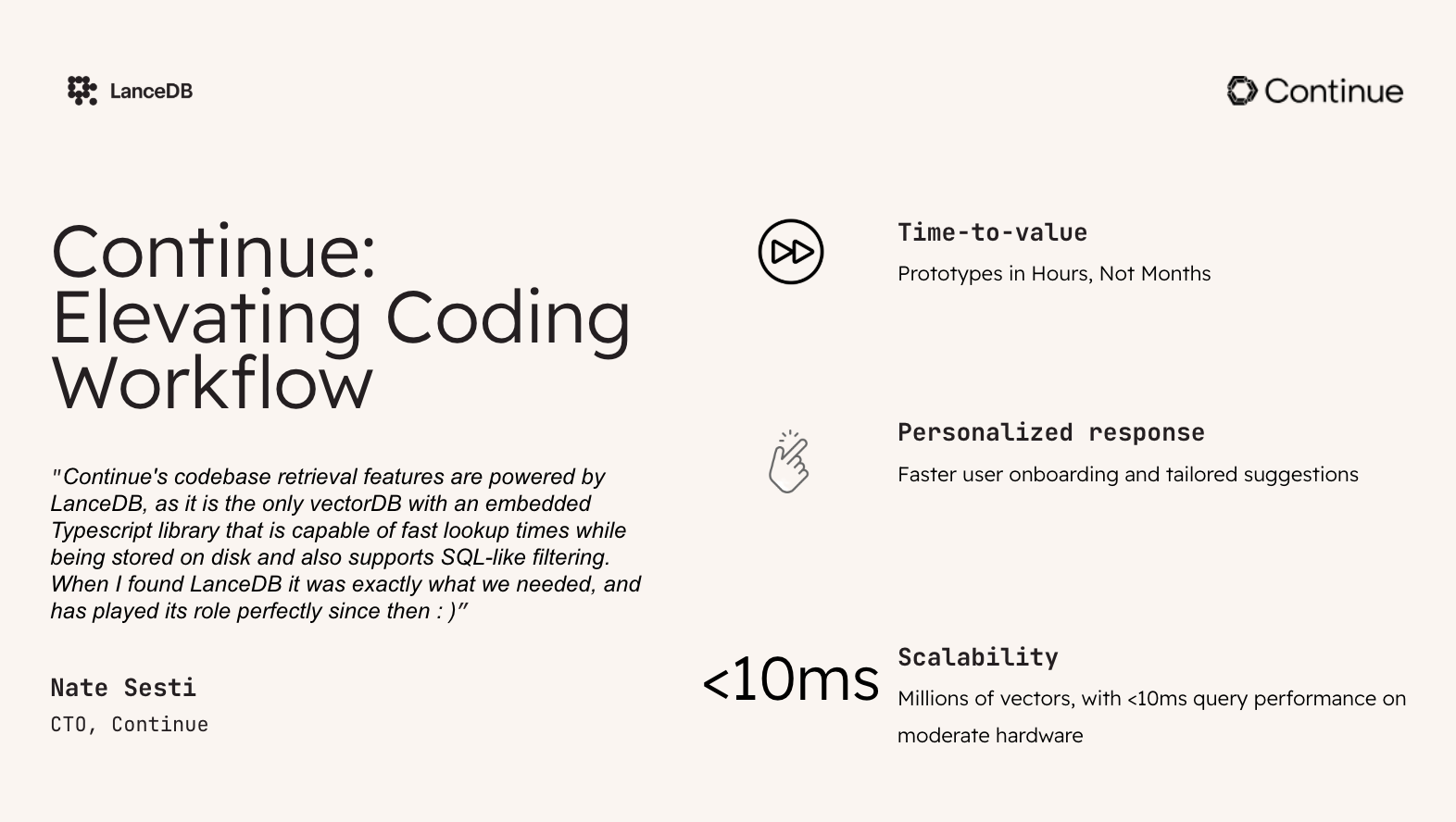

在评估了多种方案后,Continue 选择了 LanceDB 作为其核心检索系统的基石。LanceDB 是目前唯一支持嵌入式 TypeScript 库、且具备高性能磁盘存储和 SQL 过滤能力的向量数据库。

“LanceDB 的优势在于它可以直接在内存中运行,并提供 Python 和 Node.js 的原生支持。这让我们的开发团队能够专注于编写业务逻辑,而不是浪费时间在繁琐的基础设施搭建上。” —— Nate Sesti, Continue 联合创始人兼 CTO

技术实现架构

Continue 利用 LanceDB 构建了完整的 RAG(检索增强生成)系统,其工作流程分为以下五个关键步骤:

- 语义嵌入 (Embedding):利用 Voyage AI 等模型将代码函数、文档和片段转换为高维向量,捕捉代码背后的逻辑含义。

- 本地代码库摄取:系统自动爬取本地仓库,将代码切分为约 10 行的小块。对于千万级行数的代码库,LanceDB 能高效处理生成的百万级向量。

- 极速索引:通过 LanceDB 的向量与标量混合索引,即使在海量数据下也能实现毫秒级的检索响应。

- 上下文感知查询:当开发者提问“如何处理 API 重试逻辑?”时,Continue 会调用 LanceDB 进行向量搜索,并结合 SQL 过滤器(如语言、项目、标签)精确锁定最相关的代码片段。

- 无缝更新:代码仓库的细微变动无需重新构建整个数据库,LanceDB 支持仅对受影响的向量进行增量更新。

实际成效:数据说话

集成 LanceDB 后,Continue 在性能和用户体验上实现了质的飞跃:

- 开发效率提升:自动代码补全的建议相关性提升了 40%,大幅减少了调试时间。

- 卓越的扩展性:在普通配置的硬件上,处理超过 100 万个向量 的查询延迟仍保持在 10 毫秒 以内,且内存占用极低。

- 个性化体验:针对特定领域的开发者(如机器学习),系统能更精准地推送 PyTorch 或 TensorFlow 的相关代码示例。

展望未来:迈向多模态与协作

Continue 的愿景远不止于代码补全。随着 LanceDB 对多模态原生支持和多向量搜索能力的不断进化,未来的 AI 助手将能够像理解函数一样理解设计图、PDF 文档、甚至是教学视频。

企业级用户也将从中受益。LanceDB 提供的云端扩展能力将确保大型团队在遵循合规性与安全性的前提下,实现跨团队的代码知识库共享。

总结

AI 原生开发的未来属于那些能够将 AI 无缝融入现有工作流、同时不牺牲速度与隐私的工具。Continue 与 LanceDB 的结合证明了:本地优先并不意味着性能妥协,反而是构建下一代专业级开发环境的关键所在。

想要深入了解?

- 访问 Continue 官网 开启你的本地 AI 编程之旅。

- 探索 LanceDB GitHub 了解高性能向量数据库的奥秘。